为什么中国不拆开英伟达显卡研究,从而造出自己的国产显卡?就这么说吧,即使完整拆开了,也根本研究不明白,更别提造出来了。 你把一张RTX 4090拆得干干净净,散热片、背板、PCB全卸掉,GPU裸芯片摆在显微镜下,能看到什么?一层又一层的金属互连、密密麻麻的晶体管、数不清的焊点和TSV。这些东西确实精密到变态,但它们只是硬件的空壳子。 让这块卡真正跑得飞起的部分——驱动层、任务调度器、内存压缩算法、Tensor Core指令集优化、各种专有加速原语——全都不在你拆下来的硅片里。这些东西活在几千万行闭源代码和专有二进制blob里面。硬件拆一万次,灵魂你照样摸不着边。 退一万步讲,假设你通过极端手段拿到了完整RTL级设计资料,下一道坎直接把99%的人拍死:你造不出来。 从EUV光刻机光源的13.5纳米波长稳定输出,到多重曝光的对准精度,再到原子层沉积的薄膜均匀性、化学机械抛光的亚纳米平整度、低k介质的缺陷控制、CoWoS/SoIC先进封装的微凸点共面性…… 随便哪一个参数没卡住,良率直接归零,不是钱砸下去就能解决的问题,是需要十年以上体系化试错才能攒出来的工程经验。 更狠的是时间这把刀。半导体赛道是超高速列车,你花三五年把上一代架构勉强复刻出来,英伟达已经把Blackwell甚至下一代推上市场了,你辛辛苦苦做出来的东西,一上市就是性能落后、功耗爆炸、生态为零的过气货,市场根本不认。 而生态才是真正锁死竞争的铁链。CUDA不是一个SDK,而是一个二十多年滚雪球滚出来的开发者帝国,现在几乎所有主流深度学习框架、生成式AIpipeline、大规模科学计算软件、实时光追引擎,都围绕CUDA那一套API、库、编译器路径深度捆绑。 你就算硬造一块性能差不多的卡,没有匹配的软件栈,开发者懒得迁移代码,训练机构不会买,游戏厂商不会适配,玩家更不可能为“兼容性彩票”掏钱。 中国这几年其实已经把幻想彻底掐死了,靠买卡拆解、靠逆向工程、靠当寄生者弯道超车——这条路走不通,也没人再信了。现在的打法很清楚:从地基开始自己干。 自己画架构图,自己写前端编译器+后端驱动,自己搞工具链,自己建开发者社区,哪怕每一步都疼得要命,也要保证核心环节不被别人捏住脖子。 国家层面把海量资金砸进基础研究、自主EDA、先进制程预研、关键材料;几家头部玩家则在全新指令集和并行模型上死磕,虽然现阶段产品和旗舰对比还有明显代差,但至少不再是完全跟随别人的影子跑,而是开始尝试走出一条不被牵着走的路线。 说白了,显卡从来不是一块插在主板上的卡,它是一整条从晶圆到最终应用的垂直产业链,想真正站稳脚跟,唯一的出路就是自己从最底层开始一砖一瓦盖房子,而不是指望撬开别人盖好的城堡然后住进去。 这条自主路苦、贵、慢、见效周期长,但它至少是一条活路。另一条——拆卡抄作业——表面爽快,实际上是条越走越窄的死巷子。 大家怎么看?按现在的节奏和投入力度,国产高性能GPU要到什么时候才能在主流AI训练和推理市场上站稳一席之地?

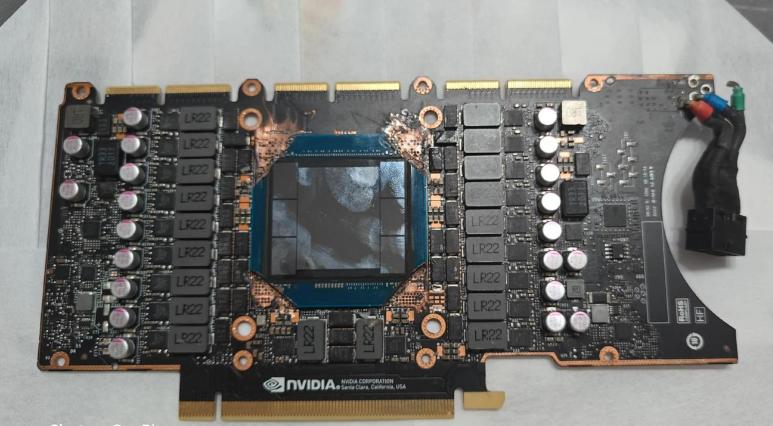

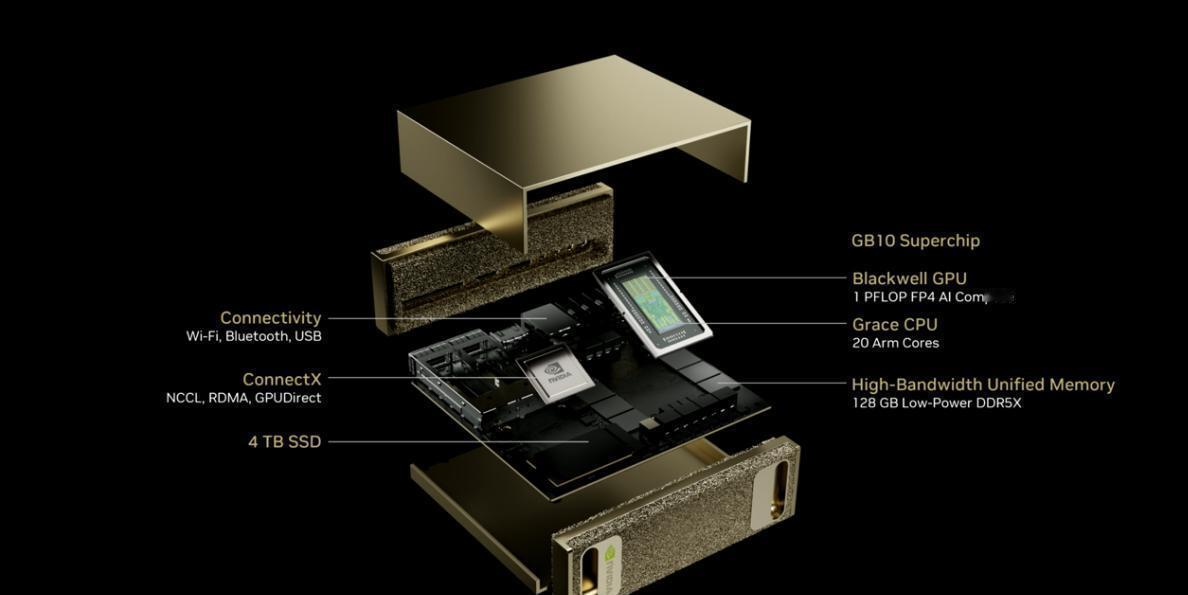

评论列表