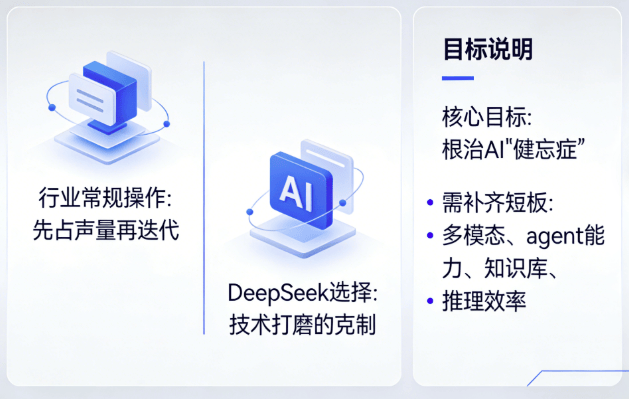

DeepSeek V4版本发布引发AI圈广泛关注,此前全行业翘首以盼,各大厂纷纷扎堆发布新版本抢占声量,而DeepSeek创始人梁文锋却选择推迟V4发布,拒绝“先占声量再迭代”的行业常规操作,背后是其对技术打磨的克制,核心目标是根治AI“健忘症”,同时补齐多模态、agent能力等四大短板。

AI生成

据外媒报道,DeepSeek V4属于架构级重构,包含1万亿参数、百万上下文、原生多模态等核心升级,原计划于4月份发布,此次推迟核心原因是聚焦LTM(长期记忆)技术的打磨。LTM技术可让AI跨对话、跨任务记住用户偏好与对话内容,从架构层解决当前AI“天生不记事”的痛点,而这正是OpenClaw最薄弱的环节。

不同于行业内普遍采用的外挂记忆插件方案,梁文锋团队选择将记忆能力直接嵌入模型架构本身,依托Engram论文技术,开辟专用记忆空间,实现记忆无限扩容且不增加推理成本,有望跳过“外挂记忆”范式,进入AI原生记忆时代,从根上解决OpenClaw存在的压缩损耗、检索失效、容量有限等记忆缺陷。

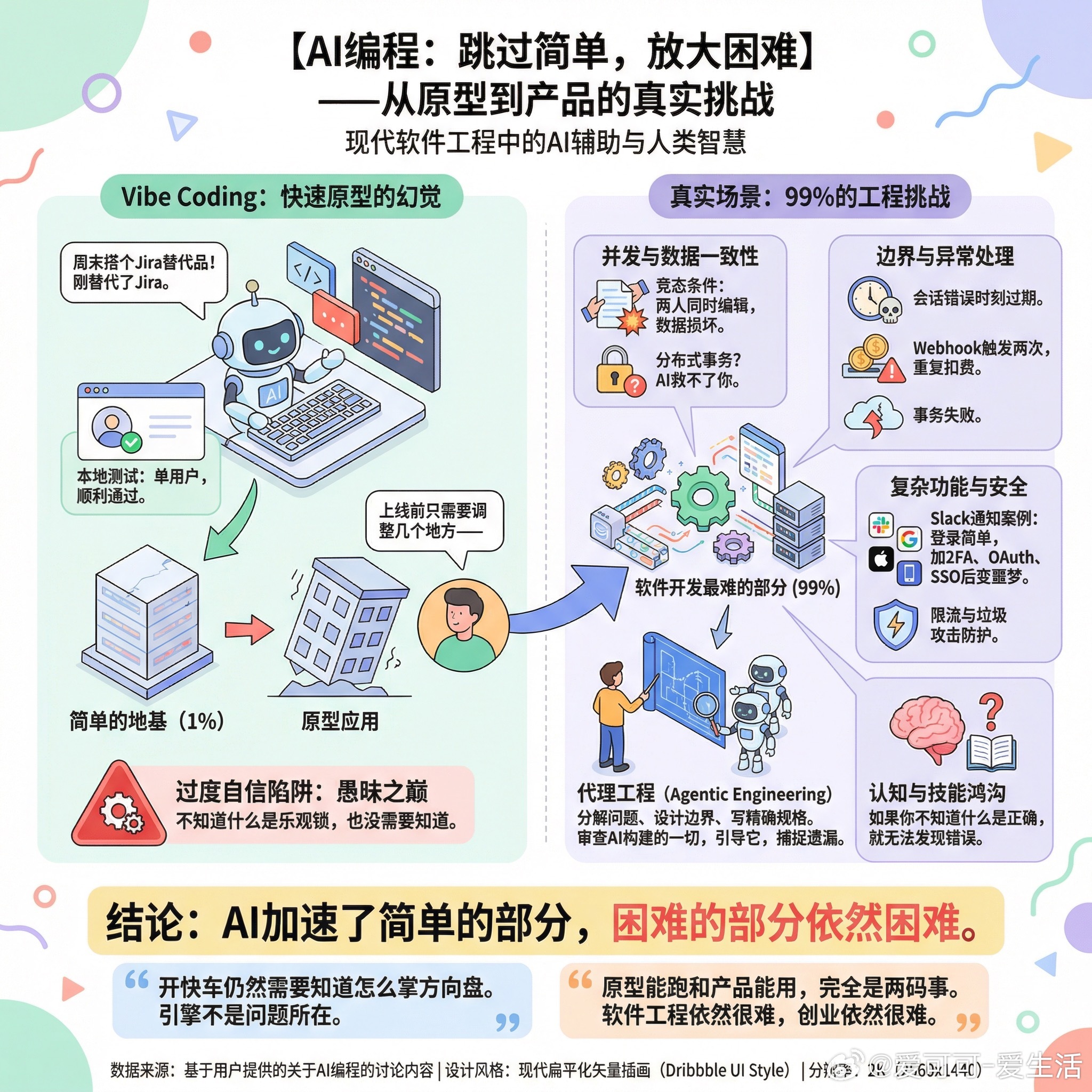

除了深耕LTM技术,梁文锋推迟发布还为补齐DeepSeek四大短板:目前DeepSeek仍是纯文本模型,多模态能力落后于同行;agent能力、AI编程能力与GPT、Claude等产品存在差距;AI搜索存在高幻觉率,依赖第三方接口导致信息源不可控。这些短板均需架构级优化,无法小修小补解决。

业内人士透露,梁文锋的克制源于对产品的高要求,此前DeepSeek R1一炮封神,靠的就是“不抢跑、求极致”。此次推迟V4,并非拖延,而是为了待所有模块调试到位后再出手。腾讯首席AI科学家姚顺雨的研究也印证了这一方向的价值,当前AI的核心瓶颈的是上下文学习与记忆能力,这也是2026年AI行业的核心主题。

目前,DeepSeek V4的最终发布时间尚未明确,业内推测若调试未达预期,不排除进一步跳票可能。对梁文锋而言,“不发”永远比“发错”重要,而此次架构级重构若能成功,或将重塑AI行业竞争格局,推动AI向“可成长、善记忆”的方向迈进。

评论列表