【得益于 Apple 的 MLX 框架,Ollama 现在在 Mac 上运行速度更快】

本地运行 AI 模型的 Ollama 发布了一项更新,该更新利用了 Apple 的机器学习框架 MLX。更新后,搭载 Apple 芯片的 Mac 电脑运行速度显著提升。

Ollama 表示,新版本处理提示的速度提升了约 1.6 倍(预填充速度),生成响应的速度(解码速度)几乎翻倍。搭载 M5 系列芯片的 Mac 电脑据说能获得最大的性能提升,这得益于 Apple 全新的 GPU 神经加速器。

此次更新还包括更智能的内存管理,这将使 AI 驱动的编码工具和聊天助手在长时间使用时明显更加灵敏。

Ollama 表示,全新的性能提升应该尤其有利于运行 OpenClaw 等个人助理或 Claude Code、OpenCode 或 Codex 等编码代理的 macOS 用户。

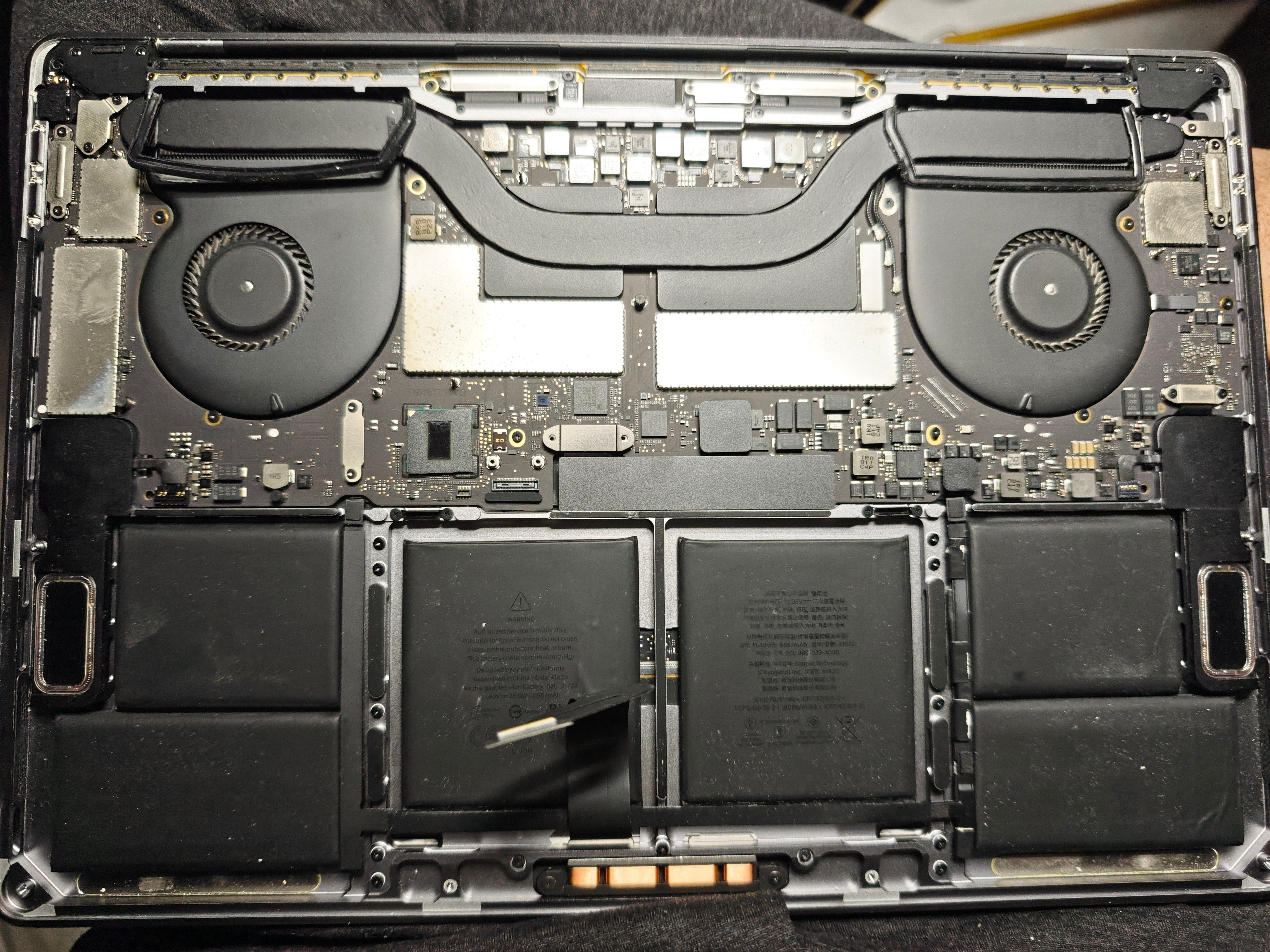

预览版现已开放下载,版本号为 Ollama 0.19——请确保你的 Mac 电脑拥有超过 32GB 的统一内存才能运行。目前仅支持阿里巴巴的 Qwen3.5,但 Ollama 表示计划支持更多 AI 模型。