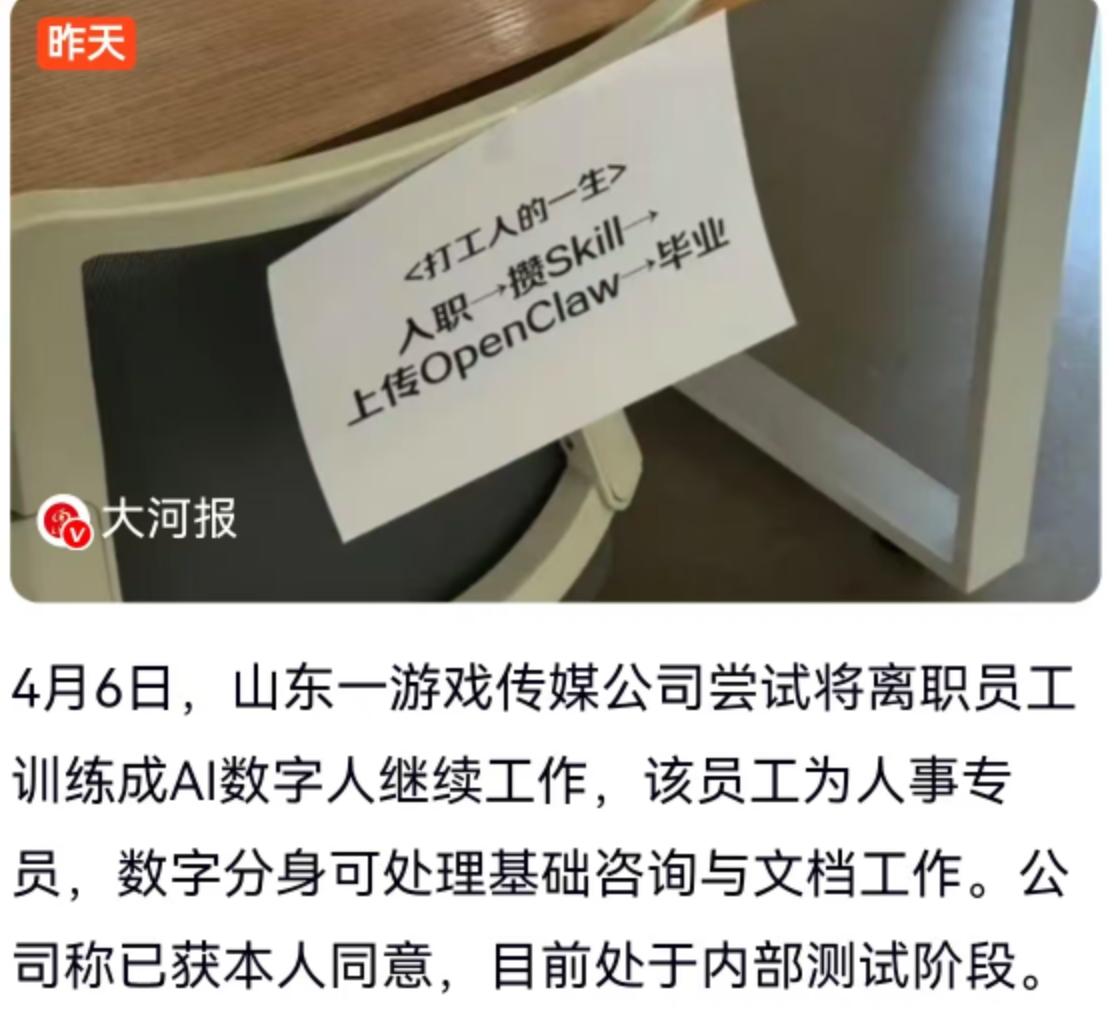

4月6日,山东一家游戏传媒公司的一波操作,直接把职场科幻片演成了现实。这家企业尝试将一名已经离职的人事专员训练成AI数字人,继续留在公司处理基础咨询与文档工作。公司方对外宣称此举已获得本人同意,目前仅处于内部测试阶段。消息一出,全网舆论瞬间沸腾,1500多名网友参与的话题投票里,质疑声铺天盖地。有人直指这是“赛博剥削”,有人调侃“人走了魂还要留下打工”,更有人一针见血地发问:“能分工资吗?” 从技术实现的角度拆解这个过程,其实并不神秘。该公司的核心手段是整合这名离职员工在职期间的聊天记录、工作文档等历史数据,将其投喂给AI模型,从而让数字分身模仿出该员工特定的工作风格与说话语气。在支持者眼中,这是一种极具性价比的交接方式。人事岗位存在大量重复性的基础问答,如果数字分身能无缝衔接这些工作,不仅降低了新老员工交替的沟通成本,还把老员工脑子里的隐性经验沉淀成了公司资产。 技术上的可行,绝不等于现实中的合理。这场争议最核心的爆破点,在于那个极其脆弱的“本人同意”。在真实的职场权力结构中,离职阶段往往是员工处于相对弱势的时期。面对前东家提出的数据采集要求,员工是否有足够的拒绝空间?即便签署了同意书,这种同意是否带有某种隐性的压力?网友那句“谁信本人同意,让自己失业吗”虽然偏激,却精准戳中了职场人情社会的复杂面相。一旦“同意”被资本或管理权力裹挟,所谓的数据授权就会沦为形式。 抛开学理上的争论,这起事件给所有打工人敲响了一记极其现实的警钟。我们在日常工作群里敲下的每一句话、整理的每一份文档,本质上都在帮公司免费训练专属于我们的AI模型。按照国内现行的《生成式人工智能服务管理暂行办法》,使用他人数据必须获得明确同意,但现实中,当你入职时签下那份冗长的保密协议与员工手册时,数据的归属权边界往往已经被模糊处理了。这位人事专员的遭遇只是一个极端的切片,明天被做成数字分身的,可能就是写代码的程序员、做设计的美术或者写文案的策划。 更深层的隐患潜伏在责任归属的盲区里。如果这个数字分身在处理人事咨询时,输出了带有歧视性的言论,或者给出了错误的文档指引导致他人利益受损,责任由谁来担?是研发数字人的公司,还是那个已经拿完离职证明的真实人类?法律在这方面目前处于空白地带。个人绝不能被当作技术试错的背锅侠。 山东这家游戏公司的内部测试,像一颗投入平静湖面的石子,提前把未来十年的职场伦理冲突甩到了大众面前。面对这种不可逆的技术趋势,单纯的愤怒或抵制毫无意义。对于普通职场人而言,真正具有实用价值的应对策略,是在日常工作中建立起清晰的“数据防火墙”。区分哪些是公司硬性要求的标准化产出,哪些是可以作为个人护城河的核心洞察力。机器可以模仿你的语气回复邮件,却无法替代你在复杂人际利益博弈中的临场决断。把重复性劳动交给系统,把不可替代性握在自己手里,才是对抗“赛博化”生存的唯一解法。至于那些想着用数字分身白嫖劳动力的企业,先把离职员工的工资结清,再谈技术情怀也不迟。 以上内容仅供参考和借鉴