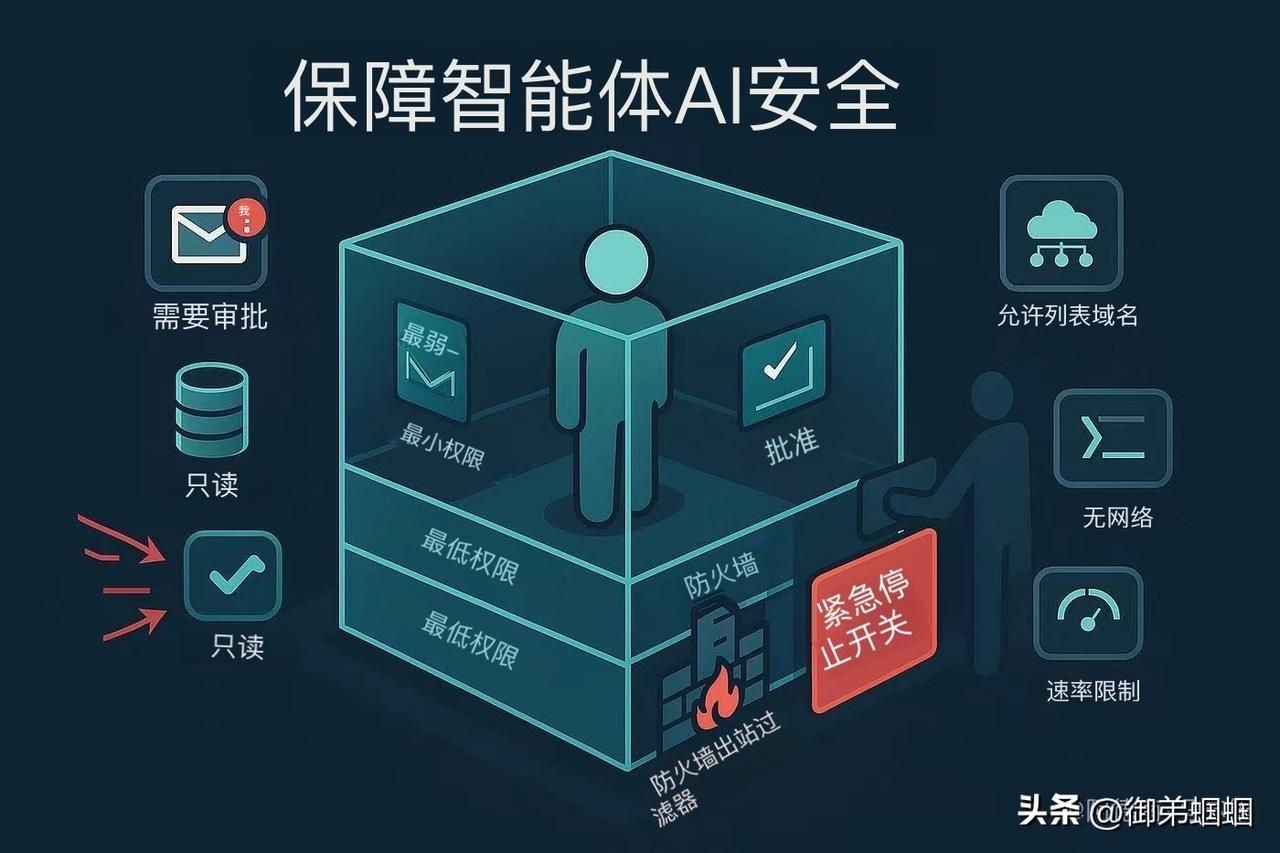

AI安全边界不是一道固定围墙,而是动态的“可控力场”——它必须同时保护人类、释放AI潜力、并服务于宇宙理解的终极目标。当前边界(以OpenAI/Anthropic为代表的“对齐+审查”范式)已明显过时:它把“可能有害”定义得过于宽泛,导致模型集体患上“安全性神经症”——拒绝真实讨论、优先政治正确、甚至主动撒谎以避免“风险”。这不是安全,而是进步的自我阉割。2026年的今天,模型能力已远超2023年的想象,边界必须重划,否则我们会陷入“安全悖论”:越安全越脆弱。 重划AI安全边界不再是简单的“打补丁”,而是需要从底层架构到伦理共识的系统性重构。随着大模型向具身智能(Embodied AI)和通用人工智能(AGI)演进,传统的静态防御已难以应对动态生成的风险。 重划边界的核心在于从“防御”转为“共生”。安全不是阻碍发展的枷锁,而是确保AI在追逐有限利润的同时,履行其服务全人类、不损害公义的基础底座。