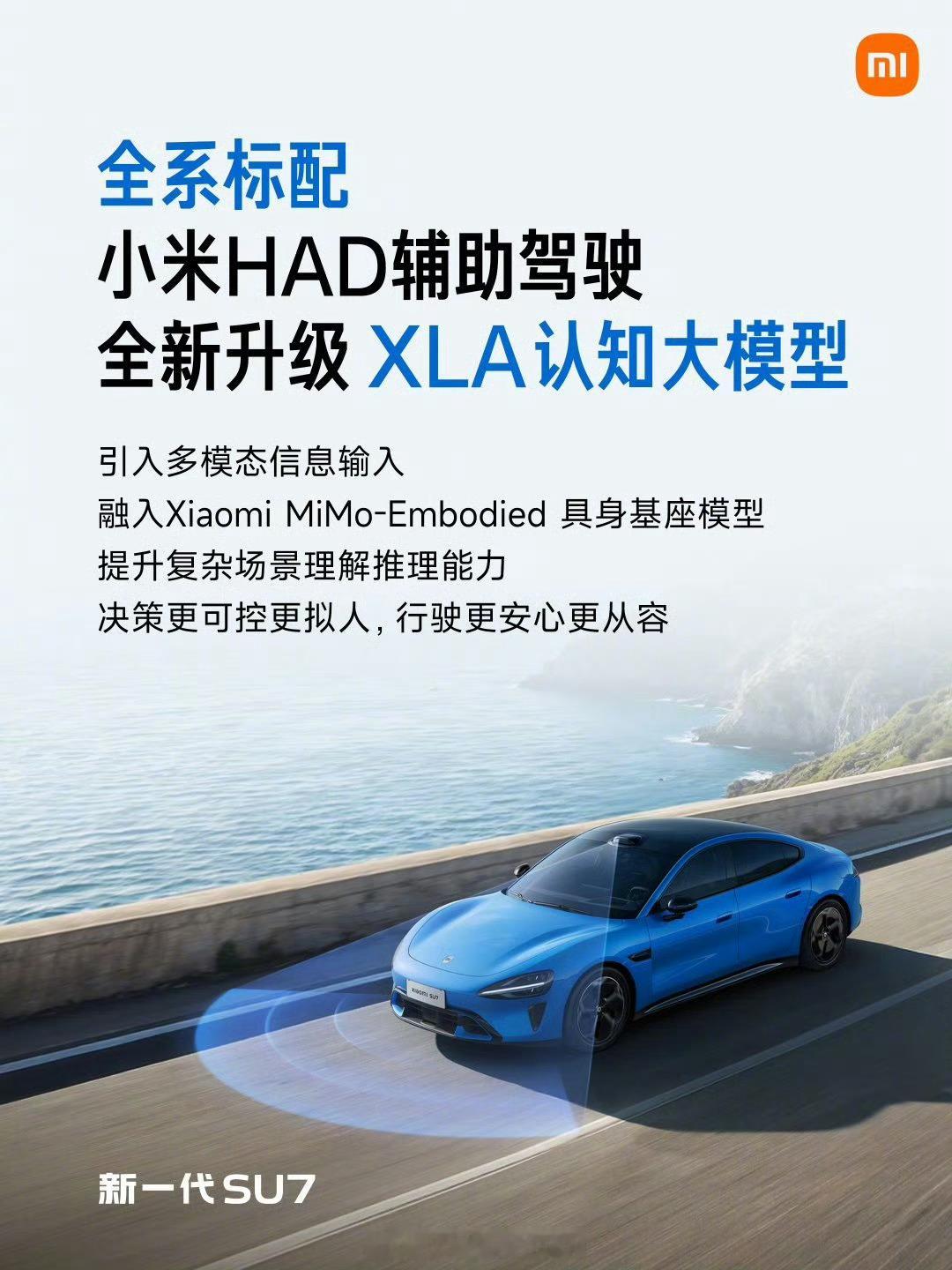

小米新SU7辅助驾驶升级XLA大模型

用最简单的话,给大家科普一下小米这次的XLA升级了啥,有什么优势。

首先是多模态输入,XLA这套大模型在之前的基础上,扩展了更多视觉、听觉、激光雷达的信息,把这些信息也融入到了辅助驾驶的决策里,从体验层面上来讲,你可能会觉得XLA更像老司机,因为它是真的在观察路况,甚至可能比你看的还全。

第二是融入了「Xiaomi MiMo-Embodied」,这个模型是小米给机器人和自动驾驶开发的基座模型,也是目前行业里面唯一打通这两个领域的模型。

单纯从车的层面上来讲,就是能够进一步提升决策的可控和拟人。但我它最核心的优势,还是把具身智能和自动驾驶领域做了融合,展示小米的AI战略和路线,真的是在一步步推。

因为很多车企都在做自动驾驶和机器人,并且告诉大家这两个领域殊途同归,但最后你会发现真掏出东西来的没几个。

小米这边你可以很明显看到的是,几乎不画饼,机器人先搞进工厂用起来,基座模型现在车上跑一跑,虽然可能不会成为行业最热的企业,但底层技术的积累一点没耽误。

之前我觉得小米能够把车造好卖好就不错了,是真的没想到小米会在AI上投如此多的资源,并且业务之间几乎没有壁垒,这也再次体现了雷总战略的前瞻性。

反正我的观点一如既往,智驾这个事只要愿意堆资源就能跑出来,小米不差这一点,所以只是时间问题。

我更好奇的是,小米会在AI这个领域走多远,又能够建立起怎样的护城河,期待小米的未来了。