【Kimi团队提出𝑨𝒕𝒕𝒆𝒏𝒕𝒊𝒐𝒏 𝑹𝒆𝒔𝒊𝒅𝒖𝒂𝒍𝒔】

快速阅读Kimi团队提出Attention Residuals,用学习式的跨层注意力机制取代传统残差连接的固定累加方式。这一改动在48B参数模型上实现了1.25倍的计算效率提升,推理延迟增加不到2%。

---

Claude的分析里有句话值得琢磨:这不是在解决问题,而是在质疑一个被默认为已解决的前提。

残差连接自2015年提出后就被当作标准配置。每一层的输出以相同权重累加到最终状态,第1层和第47层拥有同等话语权。这在计算上公平,在认知上荒谬——就像把你所有记忆都当作同等重要。

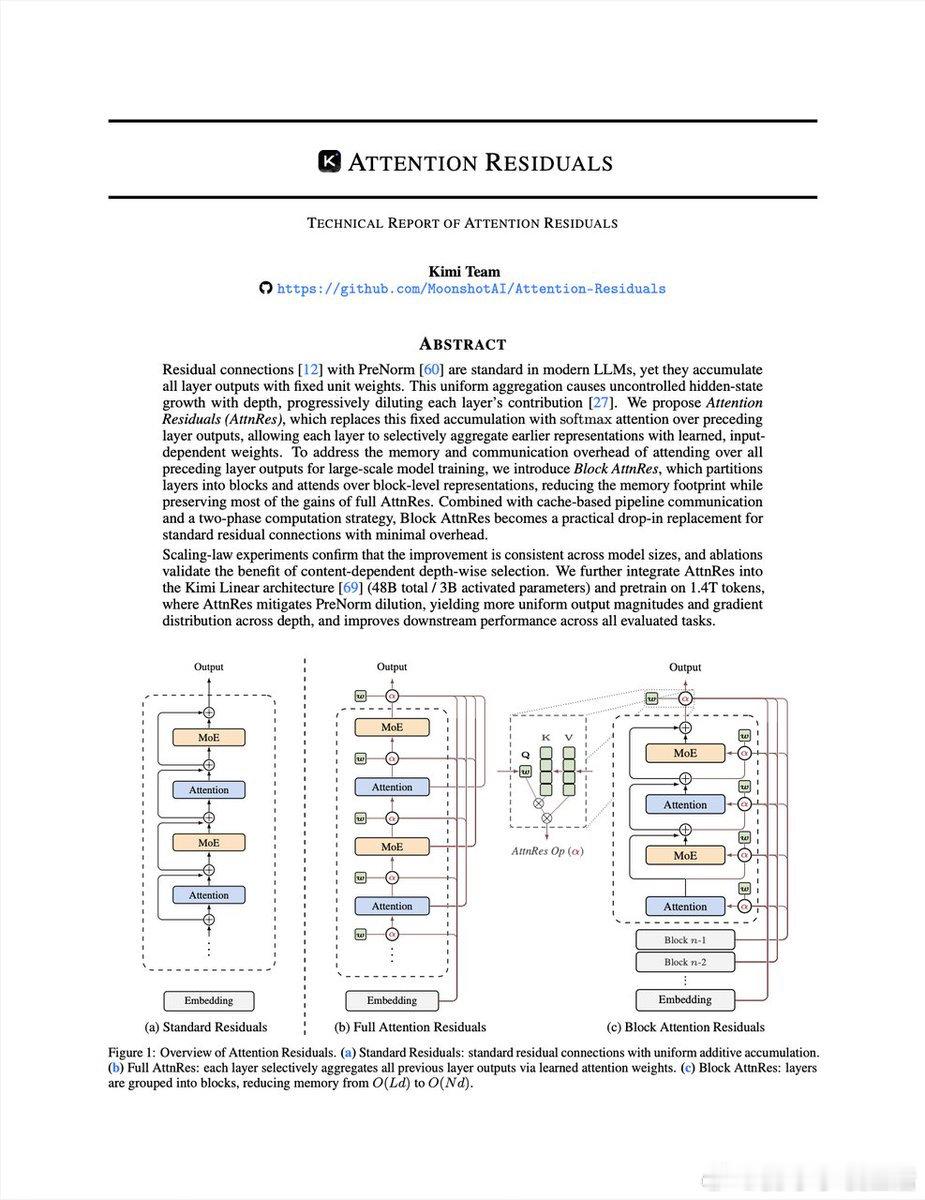

Attention Residuals的核心是让每一层主动选择需要“记住”哪些先前层的表示。不是盲目叠加,而是通过注意力机制做内容相关的检索。听起来简单,但十年里没人动这个地方。

Block AttnRes是让这个想法能落地的关键。全跨层注意力的内存开销是O(L²d),在深层网络里会爆炸。他们把层分组成块,每层只对块级表示做注意力计算,开销降到O(Nd)。训练时增加不到4%的时间,推理时延迟增加不到2%,换来1.25倍的计算效率。

训练动态的改善藏在细节里。PreNorm架构里的表示稀释和隐藏状态爆炸不只是效率问题,也是稳定性问题。AttnRes让输出幅值跨层更均匀,梯度分布更合理,同时解决这两个问题。

在Kimi Linear(48B总参数,3B激活参数)上用1.4T tokens预训练后,GPQA-Diamond涨了7.5分,HumanEval涨3.1分,数学任务涨3.6分。这些提升是架构级的,不是靠堆算力。

有观点认为深度维度现在变成了可以被注意到的对象,网络不再是严格的顺序管道,更像是结构化的记忆系统。如果深度能被选择性检索,长上下文任务里早期信息的召回应该会得到明显改善。

有网友提到这让开源模型可以几行代码就插入这个机制,drop-in替换。效率差距可能不需要更多GPU来弥补。

但也有疑问。在Kimi K2.5这样的新架构上(1T参数、MoE、多模态、256K上下文、Agent Swarm),AttnRes的开销是否还能保持这么低?模型变大变复杂后,跨层注意力会不会被放大?

有人说这是今年看到的结构上最优雅的论文之一。有人说我们正在碰到传统算法工程的收益递减定律。也有人想知道能否把提示词的结构压缩成数学上的算法改进。

第一作者陈光宇今年16岁。

github.com/MoonshotAI/Attention-Residuals/blob/master/Attention_Residuals.pdf

AI创造营 人工智能