新智元报道

[新智元导读]极佳视界具身大模型GigaBrain-0.5M*,以世界模型预测未来状态驱动机器人决策,并实现了持续自我进化,超越π*0.6实现SOTA!该模型在叠衣、冲咖啡、折纸盒等真实任务中实现接近100%成功率;相比主流基线方法任务成功率提升近30%;基于超万小时数据训练,其中六成由自研世界模型高保真合成。

具身世界模型新一代原生范式重磅登场!

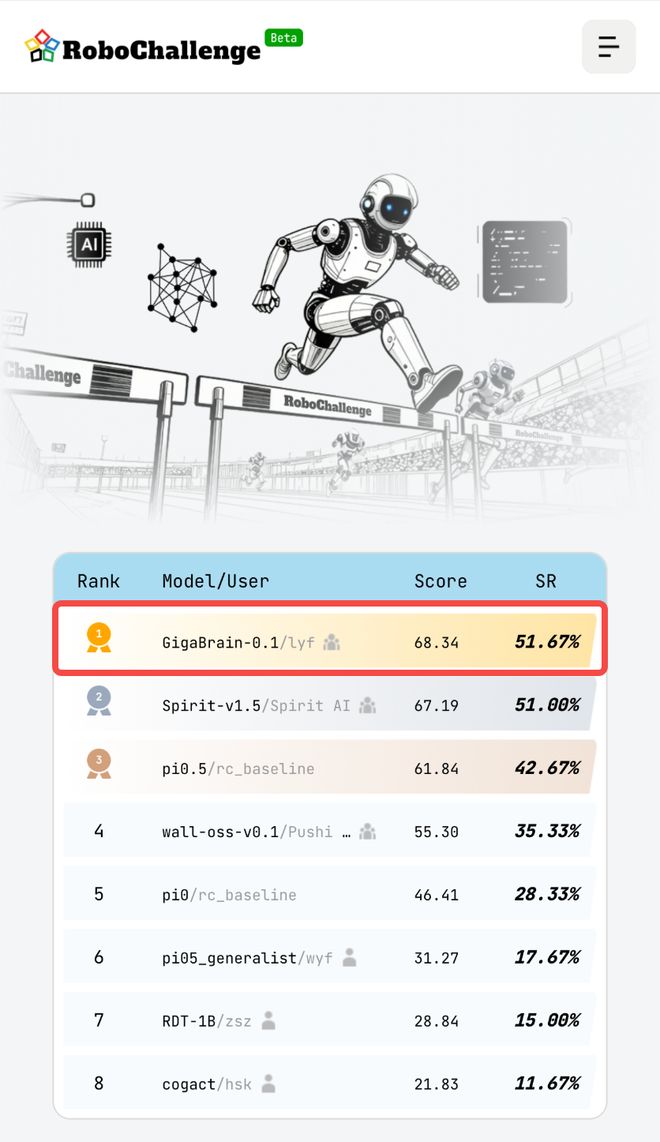

继具身基础模型GigaBrain-0.1斩获RoboChallenge全球第一后,性能更强大的GigaBrain-0.5M*又来了。

作为依托世界模型实现自我进化的VLA大模型,GigaBrain-0.5M*在家庭叠衣、服务冲煮咖啡、工业折纸盒等多个真实机器人任务中,均实现零失误、可持续稳定运转。

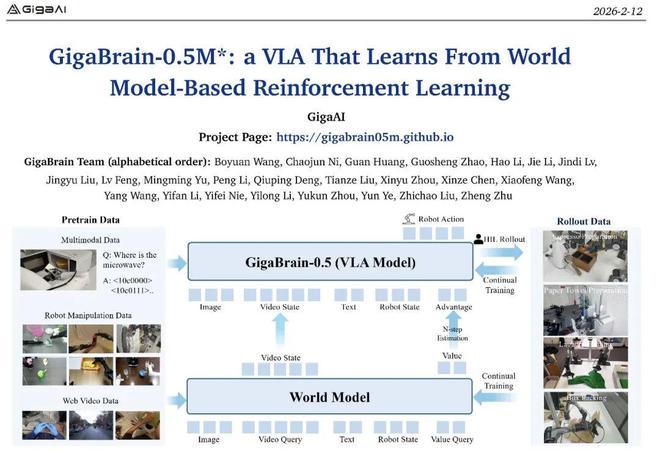

GigaBrain-0.5M*作为一款基于世界模型条件驱动(WorldModel-Conditioned)的VLA大模型,以世界模型对未来状态与价值的预测结果作为条件输入,可显著提升模型在长时程任务中的鲁棒性。

在此基础上,GigaBrain-0.5M*创新引入人在回路(Human-in-the-Loop)持续学习机制,系统依托经人工筛选与校正的模型推演轨迹开展迭代训练,基于真实环境交互反馈持续优化决策策略,最终实现「行动—反思—进化」的闭环式持续学习与自主迭代升级。

项目链接:https://gigabrain05m.github.io/

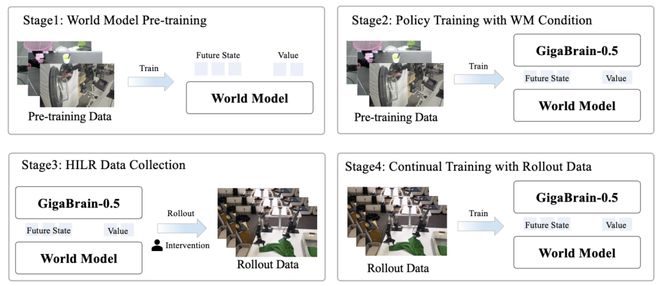

基于世界模型的强化学习的训练范式

在GigaBrain-0.5M*的研发中,极佳视界提出基于世界模型的强化学习范式,并采用迭代式四阶段闭环训练流程:

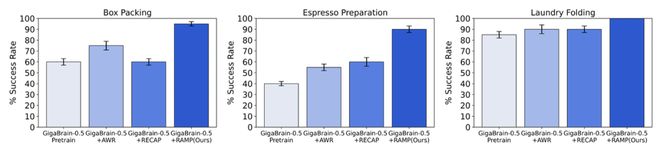

连续零失误执行

在与AWR、RECAP等主流模仿学习与强化学习基线方法的系统对比中,GigaBrain-0.5M*展现出显著优势,在相同任务设定下,相较于由π*0.6所提出的RECAP基线,任务成功率提升近30%,并实现了稳定可靠的模型效果。

尤其在高难度长时程任务中,面对折纸盒、咖啡制备、衣物折叠等包含多阶段操作、精细感知与持续决策的复杂场景,GigaBrain‑0.5M*均实现接近100%的任务成功率,并可稳定复现成功执行轨迹,充分彰显出卓越的策略鲁棒性。

折纸盒

咖啡制备☕

衣物折叠

高效且准确的价值预测

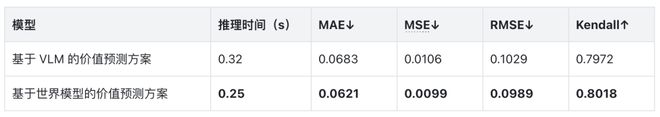

实验结果表明,基于世界模型的价值预测方案在执行效率与预测精度上,均优于π*0.6提出的VLM方案。

该方案的核心优势源自对未来状态的显式建模与世界模型单步降噪机制,可为价值函数提供关键的时序上下文支撑,让价值估计实现更高效、更精准、更稳定的输出。

以叠衣服任务为例:

任务初期,机械臂反复调整衣物姿态时,预测价值呈现合理波动;

当衣物摆正、进入稳定叠放阶段,价值曲线稳步上升;

若中途出现干扰物,价值骤降以反映任务受阻;

待干扰物被移除后,价值迅速恢复增长趋势。

这种与任务物理进程高度对齐的价值演化,正是世界模型提供「认知先验」的直接体现。

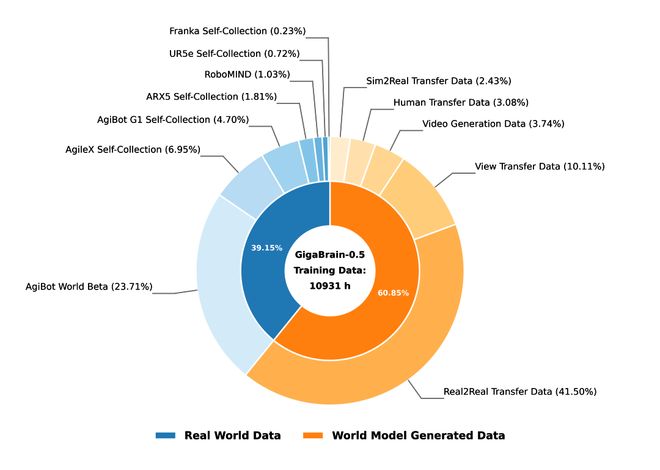

上万小时的训练数据

GigaBrain-0.5M*的基座模型GigaBrain-0.5基于总计10931小时的多样化机器人操作数据进行预训练,其中61%(6653小时)由自研具身世界模型GigaWorld高保真合成,覆盖纹理迁移、视角变换、人手到机械臂映射等丰富场景;

剩余39%(4278小时)源自真实机器人采集,确保策略在物理世界中的可执行性。

海量数据的引入显著拓展了模型的任务覆盖广度与策略鲁棒性,使其在面对复杂、长时程操作任务时具备更强的泛化能力;

而GigaWorld生成的合成数据则有效突破了真实采集的长尾瓶颈。

通过可控地生成新纹理、新物体位姿与新观测视角下的训练样本,增强了模型在分布外场景中的适应性,为具身智能走向开放世界奠定了数据基石。

关于极佳视界

极佳视界是一家具身智能和通用机器人公司,围绕「基模—本体—场景」三位一体,为工业、商业、家庭等场景提供软硬一体的具身智能机器人解决方案,推动通用机器人服务千行百业、走进千家万户。

公司核心团队包括清华、北大、中科院、中科大、WashU、CMU等全球知名院校顶尖研究人员,以及来自微软、三星、地平线、百度、博世等全球知名企业高管,核心团队在物理AI方向兼具业内领先的研究能力和大规模的产业落地经验。

极佳视界是国内第一家布局世界模型的科技公司,以世界模型平台GigaWorld、通用具身大脑GigaBrain、原生本体Maker构建闭环生态,致力实现10-100倍以上的数据、训练、测试全链路效率提升,推动通用具身智能机器人、通用自动驾驶等物理AGI大规模爆发。

参考资料:斩获全球第一后,更强大的GigaBrain-0.5M*来了,世界模型原生的新一代范式登场!