在PC硬件圈里,迷你主机通常被看作是办公辅助或者轻量级娱乐的选择,但技嘉最新推出的AI TOP

ATOM彻底打破了这一刻板印象。这款设备直接把数据中心级别的AI算力压缩到了巴掌大的机身里,定位是“个人AI超级电脑”。对于游戏玩家、AI开发者、科研人员,甚至是只要有本地化大模型需求的小型工作室来说,这台小机器带来的可能是一场效率革命。

核心算力来自NVIDIA

GB10 Grace Blackwell芯片。这是一颗采用台积电3纳米制程的超级芯片,将20核Arm v9.2架构的Grace

CPU与Blackwell GPU封装在同一基板上。GPU部分拥有6144个CUDA核心,但由于Blackwell架构的新一代Tensor

Core支持FP4、FP8等低精度格式,在NVFP4精度下AI算力可达1000 AI TOPS。这意味着它可以流畅运行2000亿参数级别的模型。

内存配置是技嘉AI

TOP ATOM区别于普通迷你主机的关键之一。它搭载了128GB

LPDDR5x统一内存,CPU和GPU通过NVLink-C2C互联,双向带宽达到传统PCIe

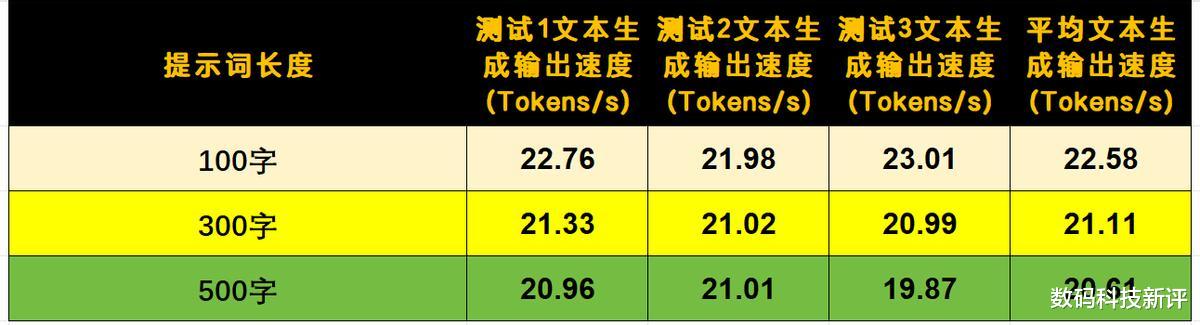

5.0的五倍。这种统一内存架构直接消除了“显存墙”问题——加载GLM-4.5-Air 106B

NVFP4模型时,显存占用约68-69GB,仅消耗一半左右的容量,剩余空间可以同时运行Embedding和Rerank等辅助模型,无需在多个模型之间反复换入换出。实测在500字长提示词场景下,文本生成速度仍能保持在20.61

Tokens/s,提示词缩短到100字时则提升至22.58 Tokens/s。并发处理方面,4路并发以内平均推理速度维持在10

Tokens/s以上。对于一台TDP仅140W、使用240W

Type-C电源适配器的迷你设备来说,这个表现完全能够支撑一个小型团队日常的模型调试工作。

扩展性上,AI

TOP ATOM配备了一个容易被忽略但极为实用的NVIDIA

ConnectX-7接口。通过这个接口,用户可以直接将两台设备互联,实现显存池化和算力叠加,从而支持4000亿参数以上的超大模型运行。这种点对点的集群扩展方式,相比万兆以太网延迟更低,相比InfiniBand部署成本也更友好。机身背部还提供了三个USB

3.2 Type-C、一个万兆RJ-45网口、一个HDMI 2.1a输出接口,无线方面支持Wi-Fi

7和蓝牙5.4。整机外观采用银灰色哑光金属外壳,无RGB灯效,横栅格通风口内部增加了强化筋条防止热变形,底部有橡胶垫脚和内凹槽辅助散热。运行时噪音控制得很好,适合需要安静环境的开发或创作场景。

软件生态是AI

TOP

ATOM实现“开箱即用”的核心支撑。技嘉与趋境科技联合预装了趋境智问本地AI应用系统,底层是基于Ubuntu的图形化AIOS。用户不需要任何命令行操作,在浏览器输入本机IP加端口号即可登录两个主要平台。趋境AIMA是管理后台,提供GPU/CPU负载、显存占用、tokens消耗等指标的实时监控,支持一键启动GLM-4.5-Air

106B、Qwen 2.5

7B等预置模型,也允许用户导入私有模型——只需将文件放在指定目录下,在界面中点击加号并设置参数即可生效,无需手写配置文件。趋境智问是应用层,覆盖AI对话、智能周报生成、长文写作、会议纪要整理、多格式文档阅读等场景。其中长文写作模块会先生成一个逻辑自洽的大纲,有效解决“启动困难”问题,虽然内容偏模板化,但配合后期人工润色可以大幅提升产出效率。会议助手模块支持实时记录、生成摘要并追踪行动项,工作流完整性做得相当到位。对于需要本地运行Stable

Diffusion或ComfyUI的用户,AI TOP ATOM也完全可以自主部署,生成过程数据完全保留在本地硬盘。

全本地化部署带来的数据安全性是另一个实际优势。所有推理和训练数据都物理停留在设备内部,不存在云端泄露风险,这对处理敏感信息的企业或个人开发者来说是一个硬性需求。同时,相比传统AI工作站动辄数万甚至数十万的投入,AI TOP ATOM的定价策略明显更低。

总体而言,技嘉AI

TOP

ATOM的价值不在于刷新跑分记录,而在于它真正降低了本地化大模型部署的门槛。硬件层面,GB10芯片加128GB统一内存的组合,提供了桌面级设备中罕见的千亿模型承载能力;软件层面,图形化的管理后台和应用平台,让没有Linux经验的新手也能在几分钟内启动自己的第一个大模型。对于AI开发者、科研人员、小型工作室乃至有数据安全需求的个人用户来说,这款产品提供了一个低成本、高效率且安全可控的全栈式解决方案,让AI超算从数据中心机柜真正走进了普通办公桌面。