麻省理工学院计算机科学与人工智能实验室研究人员发现,神经网络间短暂对齐的“引导”方式,可显著提升此前被认为不适合现代任务的架构性能。研究表明,许多“无效”网络可能只是起点不理想,短期指导能助其更易学习。这一发现为神经网络性能优化提供了新思路。

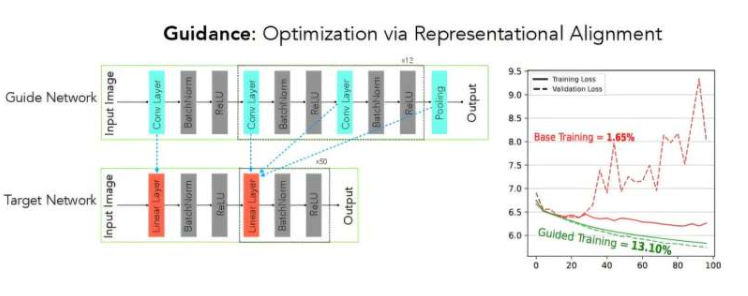

研究团队提出的指导方法,通过鼓励目标网络在训练时匹配指导网络的内部表征,将结构知识直接传递。与传统知识蒸馏不同,此方法不模仿教师输出,而是学习指导网络组织信息的方式。即使未经训练的网络,也包含可迁移的架构偏好,训练后的指导网络还能传递学习模式。麻省理工学院电子工程与计算机科学系博士生维格内什·苏布拉马尼亚姆表示:“我们能够利用表征相似性,使这些传统上‘糟糕’的网络真正发挥作用。”

研究还对比了指导方法与知识蒸馏。知识蒸馏在教师网络未经训练时完全失败,因输出无有意义信号。而指导方法仍取得显著改进,因其利用内部表征。这凸显了未经训练网络编码的有价值架构偏差,可引导其他网络有效学习。此外,该发现对理解神经网络架构意义广泛,成功或失败更多取决于网络在参数空间的位置,而非特定任务数据。通过与引导网络对齐,可区分架构偏差和学习知识的贡献。

(来源:维度网)