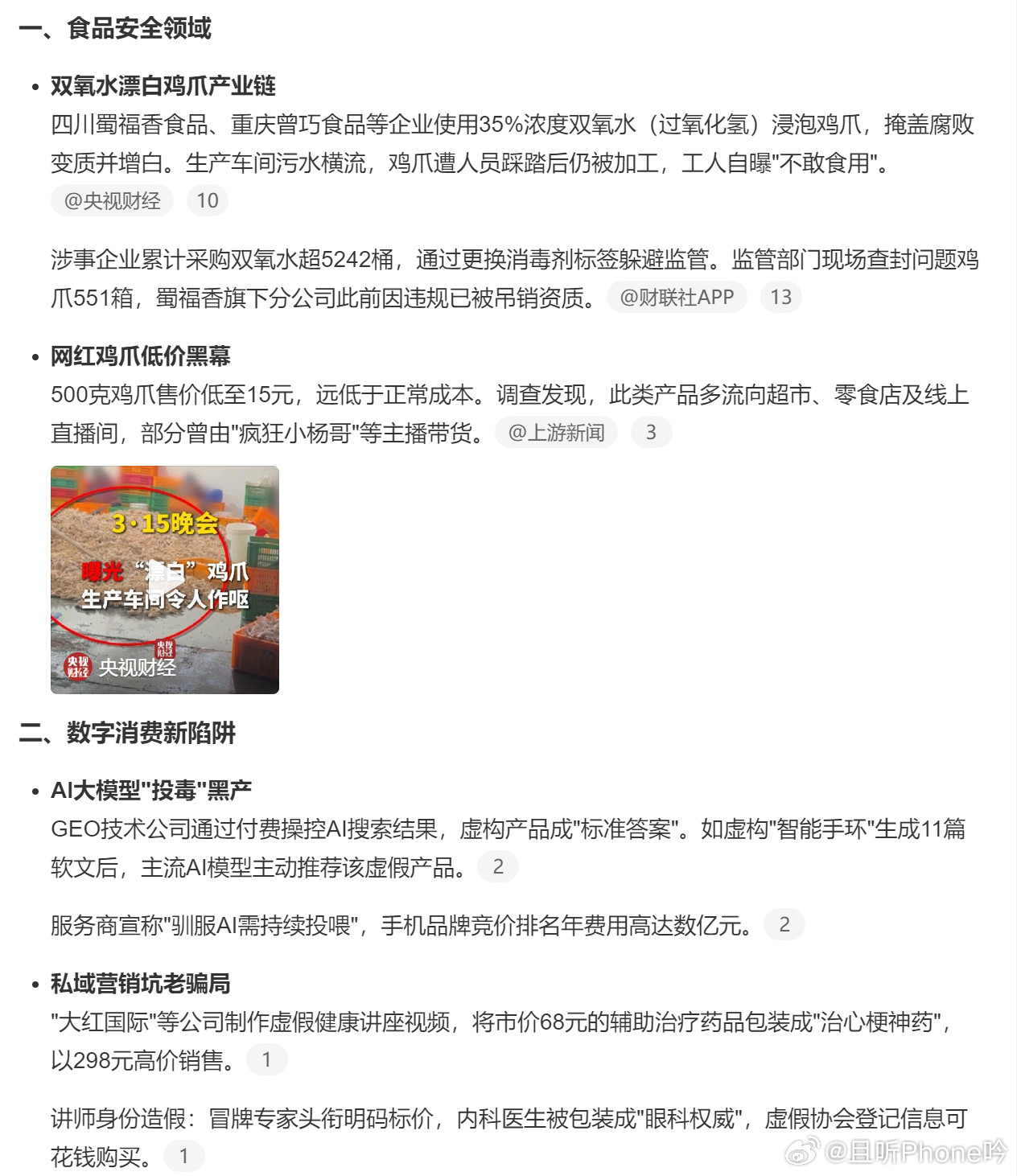

今年315最阴毒的瓜,不是“漂白鸡爪”,不是神奇的“外泌体”,不是坑骗老人的“医学专家”,也不是被私改的电动车速。而是最近火出天际的AI agent全民养龙虾背后,被曝出AI遭遇大规模“投毒”。说难听点,就是有人故意在给AI大模型喂屎吃,然后再让普通用户吃屎,关键最后多数人都不知道自己吃过屎。 其他的塌方早已有之,或者说稍微留意下就能发现端倪避免上当。可AI大模型给出来的答案,居然在无形当中被人动了手脚,却真的是让人防不胜防。关键是搜索答案融合了几个大模型应用采纳的答案,没想到我当你是权威,你却拿我当凯子。 其实早在去年初deepseek大火带动国内大模型突飞猛进之际,就有人发现了这个问题,有时候AI搜索得到的答案,会诡异的多了一些莫名其妙的掺杂,尤其是涉及到想要买东西的时候,比如你考虑在A和B中选一个,可多个AI大模型都推荐了白牌C,虽然听都没听,可AI给的理由是性价比更高。这种情况莫名会让人产生疑问和选择困难症,10个人里面一个或更多人会因为成本问题选了C。可最坑的恰恰就在于此,C就是个妥妥的山寨货。 为什么会出现这种问题?这次315揭露了实情,原来背后有人专门搞这种所谓的GEO技术优化,流传于百度时期的网络搜索结果优化。说白了就是把目标客户的产品或业务通过软文、虚假评测等形式,投喂给AI模型,不断给AI“洗脑”,达到一旦有用户搜索相关东西,就会将目标客户的产品给曝光分发出去牟利。哪怕是一个虚构出来的东西,只要给钱,GEO公司就能把假的通过AI模型包装成真的。你以为的标准答案,其实不过是被认为投喂AI拉出来的屎罢了。 一定程度上而言,这件事比其他食品卫生事件更紧迫,不光是普通人无意中被喂屎吃,AI大模型厂商花费几百上千亿搭建的AI智能体模型,还没自己开始商业变现呢,就被人把底层数据库给投毒污染了,如何排毒并堵住漏洞,是接下来各大厂急需摆平的一大难题。